« Utiliser Atelier » : différence entre les versions

Aucun résumé des modifications |

|||

| Ligne 41 : | Ligne 41 : | ||

==Évaluation de l'atelier== | ==Évaluation de l'atelier== | ||

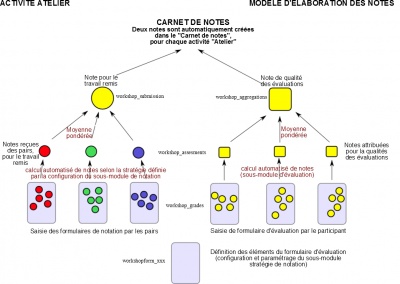

Les notes pour l'activité Atelier sont obtenues progressivement à travers un processus de saisie et de calcul, puis elles sont finalisées et mémorisée dans le [[Activité:Carnet de notes|"Carnet de notes"]]. Le schéma suivant illustre le processus d'élaboration des deux notes finales et fournit également les noms des tables de base de données dans lesquelles les valeurs sont mémorisées. | |||

[[Image: | [[Image:schéma-notes-Atelier.jpg|400px|thumb|left|Schéma d'élaboration et calcul des notes de l'activité Atelier]] | ||

<br clear="all"/> | <br clear="all"/> | ||

Version du 17 février 2017 à 13:34

Remarque : la traduction de cette page n'est pas terminée. N'hésitez pas à traduire tout ou partie de cette page ou à la compléter. Vous pouvez aussi utiliser la page de discussion pour vos recommandations et suggestions d'améliorations.

Objet de l'activité Atelier

L'atelier permet l'évaluation par les pairs et contient de nombreuses options permettant des scénarios pédagogiques complexes. Reportez vous à la page dédiée à la présentation de cette activité dans la documentation pour en comprendre l'intérêt.

Étapes de fonctionnement de l'atelier

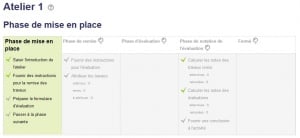

L'activité atelier fonctionne selon un processus en cinq étapes. Le processus complet de travail dans un atelier peut se dérouler sur plusieurs jours voire plusieurs semaines. C'est l’enseignant qui décide de la commutation des différentes phases.

Le travail dans l'atelier suit un processus linéaire passant par les étapes suivantes : Mise en place, Remise des travaux, Évaluation, Notation de l'évaluation, et se termine par l'étape Fermé. Cependant, un processus par itérations successives reste possible.

La progression de l'activité peut être suivie dans l'écran de planification de l'activité. Celui-ci affiche les phases possibles de l'Atelier en surlignant la phase en cours. Les tâches à exécuter par le participant sont listées pour chaque étudiant avec une indication si la tâche est finie, à finir ou éventuellement invalidée.

Étape de mise en place

Dans cette première étape, les participants à l'atelier ne peuvent rien faire (ni corriger les travaux rendus, ni modifier leurs évaluations).

Les enseignants, gestionnaires ou animateurs du cours utilisent cette phase pour configurer les paramètres de l'atelier et définir la stratégie de classement des formulaires d'évaluation. Vous pouvez activer cette étape chaque fois que vous avez besoin de régler les paramètres de l'atelier ou d'empêcher les utilisateurs de modifier leur travail.

Étape de remise des travaux

Dans la phase de remise des travaux, les participants à l'atelier présentent leur travail ("soumission des travaux").

Des dates de contrôle d'accès peuvent être définies de telle sorte que, même si l'Atelier est maintenu dans cette phase, la possibilité de remise des travaux est limitée à la période donnée. Il est possible d'indiquer une date (et heure) de début de remise du travail, ainsi qu'une date de fin, ou les deux.

Étape d'évaluation par les pairs

Si la configuration de l'Atelier prévoit l'évaluation par les pairs, c'est la phase où les participants à l'atelier apprécient les travaux qui leur sont soumis à évaluation.

Comme dans la phase de remise des travaux, l'accès peut être limité par des groupes horaires de début et de fin d'autorisation d'évaluation.

Étape de notation des évaluations

L'objet principal de cette phase est de calculer deux notes finales. En effet, les participants reçoivent une note pour leur travail (calculée sur base des évaluations faites par les différents participants), ainsi qu'une note pour la qualité des évaluations qu'ils ont fournies.

Cette étape permet aussi de fournir les commentaires d'évaluations pour les auteurs et les examinateurs.

Les participants à l'atelier ne peuvent plus modifier leurs soumissions ou leurs évaluations pendant cette phase. Les gestionnaires de cours peuvent annuler manuellement les notes calculées. En outre, les soumissions sélectionnées peuvent être définies comme étant publiées afin qu'elles soient disponibles pour tous les participants à l'atelier dans la phase suivante. Voir Atelier FAQ pour obtenir des instructions sur la façon de publier des soumissions.

Fermeture de l'atelier

Chaque fois que l'Atelier passe à cette phase, les notes finales calculées au cours de la phase précédente sont insérées dans le cours Carnet de notes. Les notes de l'Atelier figurant dans le Carnet de notes et dans l'atelier. Les participants peuvent consulter leurs soumissions, leurs évaluations de soumissions et éventuellement d'autres présentations publiées dans cette phase.

Évaluation de l'atelier

Les notes pour l'activité Atelier sont obtenues progressivement à travers un processus de saisie et de calcul, puis elles sont finalisées et mémorisée dans le "Carnet de notes". Le schéma suivant illustre le processus d'élaboration des deux notes finales et fournit également les noms des tables de base de données dans lesquelles les valeurs sont mémorisées.

As you can see, every participant gets two numerical grades into the course Gradebook. During the Grading evaluation phase, course facilitator can let Workshop module to calculate these final grades. Note that they are stored in Workshop module only until the activity is switched to the final (Closed) phase. Therefore it is pretty safe to play with grades unless you are happy with them and then close the Workshop and push the grades into the Gradebook. You can even switch the phase back, recalculate or override the grades and close the Workshop again so the grades are updated in the Gradebook again (should be noted that you can override the grades in the Gradebook, too).

During the grading evaluation, Workshop grades report provides you with a comprehensive overview of all individual grades. The report uses various symbols and syntax:

| Value | Meaning |

|---|---|

| - (-) < Alice | There is an assessment allocated to be done by Alice, but it has been neither assessed nor evaluated yet |

| 68 (-) < Alice | Alice assessed the submission, giving the grade for submission 68. The grade for assessment (grading grade) has not been evaluated yet. |

| 23 (-) > Bob | Bob's submission was assessed by a peer, receiving the grade for submission 23. The grade for this assessment has not been evaluated yet. |

| 76 (12) < Cindy | Cindy assessed the submission, giving the grade 76. The grade for this assessment has been evaluated 12. |

| 67 (8) @ 4 < David | David assessed the submission, giving the grade for submission 67, receiving the grade for this assessment 8. His assessment has weight 4 |

| 80 ( |

Eve's submission was assessed by a peer. Eve's submission received 80 and the grade for this assessment was calculated to 20. Teacher has overridden the grading grade to 17, probably with an explanation for the reviewer. |

Évaluation du travail remis

The final grade for every submission is calculated as weighted mean of particular assessment grades given by all reviewers of this submission. The value is rounded to a number of decimal places set in the Workshop settings form.

Course facilitator can influence the grade for a given submission in two ways:

- by providing their own assessment, possibly with a higher weight than usual peer reviewers have

- by overriding the grade to a fixed value

Évaluation de l'évaluation des pairs

Grade for assessment tries to estimate the quality of assessments that the participant gave to the peers. This grade (also known as grading grade) is calculated by the artificial intelligence hidden within the Workshop module as it tries to do a typical teacher's job.

During the grading evaluation phase, a Workshop subplugin is used to calculate the grades for assessment. Currently there is only one standard subplugin available called Comparison with the best assessment (other grading evaluation plugins can be found in the Moodle plugins directory). The following text describes the method used by this subplugin.

Grades for assessment are displayed in the brackets () in the Workshop grades report. The final grade for assessment is calculated as the average of particular grading grades.

There is not a single formula to describe the calculation. However the process is deterministic. Workshop picks one of the assessments as the best one - that is closest to the mean of all assessments - and gives it a grade of 100%. Then it measures the 'distance' of all other assessments from this best one and gives them lower grades depending on how different they are from the best assessment (given that the best one represents a consensus of the majority of assessors). The parameter of the calculation is how strict we should be, that is how quickly the grades fall down if they differ from the best one.

If there are just two assessments per submission, Workshop can not decide which of them is 'correct'. Imagine you have two reviewers - Alice and Bob. They both assess Cindy's submission. Alice says it is a rubbish and Bob says it is excellent. There is no way of deciding who is right. So Workshop simply says - OK, you are both right and I will give you both a grade of 100% for this assessment. To prevent this, you have two options:

- Either you have to provide an additional assessment so the number of assessors (reviewers) is odd and workshop will be able to pick the best one. Typically, the teacher comes and provide their own assessment of the submission to judge it

- Or you may decide that you trust one of the reviewers more. For example you know that Alice is much better in assessing than Bob is. In that case, you can increase the weight of Alice's assessment, let us say to "2" (instead of default "1"). For the purposes of calculation, Alice's assessment will be considered as if there were two reviewers having the exactly same opinion and therefore it is likely to be picked as the best one.

Backward compatibility note

In Workshop 1.x this case of exactly two assessors with the same weight is not handled properly and leads to wrong results as only the one of them is lucky to get 100% and the second gets a lower grade.

It's not final grades that are compared

It is very important to know that the grading evaluation subplugin Comparison with the best assessment does not compare the final grades. Regardless of the grading strategy used, every filled assessment form can be seen as an n-dimensional vector of normalized values. So the subplugin compares responses to all assessment form dimensions (criteria, assertions, ...). Then it calculates the distance of two assessments, using the variance statistics.

To demonstrate this with an example, let us say you use the grading strategy Number of errors to peer-assess research essays. This strategy uses a simple list of assertions and the reviewer (assessor) just checks if the given assertion is passed or failed. Let us say you define the assessment form using three criteria:

- Does the author state the goal of the research clearly? (yes/no)

- Is the research methodology described? (yes/no)

- Are references properly cited? (yes/no)

Let us say the author gets 100% grade if all criteria are passed (that is answered "yes" by the assessor), 75% if only two criteria are passed, 25% if only one criterion is passed and 0% if the reviewer gives 'no' for all three statements.

Now imagine the work by Daniel is assessed by three colleagues - Alice, Bob and Cindy. They all give individual responses to the criteria in order:

- Alice: yes / yes / no

- Bob: yes / yes / no

- Cindy: no / yes / yes

As you can see, they all gave 75% grade to the submission. But Alice and Bob agree in individual responses, too, while the responses in Cindy's assessment are different. The evaluation method Comparison with the best assessment tries to imagine, how a hypothetical absolutely fair assessment would look like. In the Development:Workshop 2.0 specification, David refers to it as "how would Zeus assess this submission?" and we estimate it would be something like this (we have no other way):

- Zeus 66% yes / 100% yes / 33% yes

Then we try to find those assessments that are closest to this theoretically objective assessment. We realize that Alice and Bob are the best ones and give 100% grade for assessment to them. Then we calculate how much far Cindy's assessment is from the best one. As you can see, Cindy's response matches the best one in only one criterion of the three so Cindy's grade for assessment will not be as high.

The same logic applies to all other grading strategies, adequately. The conclusion is that the grade given by the best assessor does not need to be the one closest to the average as the assessments are compared at the level of individual responses, and not the final grades.

Groups and Workshop

When a workshop is used in a course using separate or visible groups and groupings, it is possible to filter by group in a drop-down menu at the Assessment phase, manual allocation page, grades report and so on.

Voir aussi

- Example workshop with data Log in with username teacher/password moodle and explore the grading and phases of a completed workshop on the Moodle School demo site.

- Research paper Moodle Workshop activities support peer review in Year 1 Science: present and future by Julian M Cox, John Paul Posada and Russell Waldron

- Using Moodle Workshop module forum

- Using Moodle forum discussion [1] where David explains a particular Workshop results

- Moodle Workshop 2.0 - a (simplified) explanation presentation by Mark Drechsler

- Development:Workshop for more information on the module infrastructure and ways how to extend provided functionality by developing own Workshop subplugins

- A Brief Journey into the Moodle 2.0 Workshop from moodlefairy's blog.