« Utiliser Atelier » : différence entre les versions

m (Typos) |

|||

| (20 versions intermédiaires par 3 utilisateurs non affichées) | |||

| Ligne 1 : | Ligne 1 : | ||

{{Atelier}} | {{Traduction}}{{Atelier}} | ||

==Objet de l'activité Atelier== | |||

L'atelier permet l'évaluation par les pairs et contient de nombreuses options permettant des scénarios pédagogiques complexes. Reportez vous à [[Atelier|la page dédiée à la présentation de cette activité]] dans la documentation pour en comprendre l'intérêt. | |||

==Étapes de fonctionnement de l'atelier== | |||

L'activité ''atelier'' fonctionne selon un processus en cinq étapes. Le processus complet de travail dans un atelier peut se dérouler sur plusieurs jours voire plusieurs semaines. C'est l’enseignant qui décide de la commutation des différentes phases. | |||

==Étapes de fonctionnement de l' | |||

Le travail dans l'atelier suit un processus linéaire passant par les étapes suivantes : Mise en place, Remise des travaux, Évaluation, Notation de l'évaluation, et se termine par l'étape Fermé. Cependant, un processus par itérations successives reste possible. | Le travail dans l'atelier suit un processus linéaire passant par les étapes suivantes : Mise en place, Remise des travaux, Évaluation, Notation de l'évaluation, et se termine par l'étape Fermé. Cependant, un processus par itérations successives reste possible. | ||

| Ligne 11 : | Ligne 11 : | ||

===Étape de mise en place=== | ===Étape de mise en place=== | ||

Dans cette première étape, les participants à l'atelier ne peuvent rien faire (ni corriger les travaux rendus, ni modifier leurs évaluations). [[Image:Atelier_Etapes_1.jpg|thumb]] | |||

Les enseignants, gestionnaires ou animateurs du cours utilisent cette phase pour configurer les paramètres de l'atelier et définir la stratégie de classement des formulaires d'évaluation. Vous pouvez activer cette étape chaque fois que vous avez besoin de régler les paramètres de l'atelier ou d'empêcher les utilisateurs de modifier leur travail. | |||

===Étape de remise des travaux=== | ===Étape de remise des travaux=== | ||

Dans la phase de remise des travaux, les participants à l'atelier présentent leur travail ("soumission des travaux"). | |||

Des dates de contrôle d'accès peuvent être définies de telle sorte que, même si l'Atelier est maintenu dans cette phase, la possibilité de remise des travaux est limitée à la période donnée. Il est possible d'indiquer une date (et heure) de début de remise du travail, ainsi qu'une date de fin, ou les deux. | |||

===Étape d'évaluation par les pairs=== | ===Étape d'évaluation par les pairs=== | ||

Si la configuration de l'Atelier prévoit l'évaluation par les pairs, c'est la phase où les participants à l'atelier apprécient les travaux qui leur sont soumis à évaluation. | |||

Comme dans la phase de remise des travaux, l'accès peut être limité par des groupes horaires de début et de fin d'autorisation d'évaluation. | |||

===Étape de notation des évaluations=== | ===Étape de notation des évaluations=== | ||

L'objet principal de cette phase est de calculer deux notes finales. En effet, les participants reçoivent une note pour leur travail (calculée sur base des évaluations faites par les différents participants), ainsi qu'une note pour la qualité des évaluations qu'ils ont fournies. | |||

Cette étape permet aussi de fournir les commentaires d'évaluations pour les auteurs et les examinateurs. | |||

Les participants à l'atelier ne peuvent plus modifier leurs soumissions ou leurs évaluations pendant cette phase. Les gestionnaires de cours peuvent annuler manuellement les notes calculées. En outre, les soumissions sélectionnées peuvent être définies comme étant publiées afin qu'elles soient disponibles pour tous les participants à l'atelier dans la phase suivante. Voir [[FAQ sur l'atelier|la page des questions fréquentes sur l'activité Atelier]] pour obtenir des instructions sur la façon de publier des soumissions. | |||

===Fermeture de l'atelier=== | ===Fermeture de l'atelier=== | ||

[[File:workshop final grades.png|thumb| | [[File:workshop final grades.png|thumb|Un atelier fermé]] | ||

Chaque fois que l'Atelier passe à cette phase, les notes finales calculées au cours de la phase précédente sont insérées dans le cours [[Carnet de notes]]. Les notes de l'Atelier figurant dans le Carnet de notes et dans l'atelier. Les participants peuvent consulter leurs soumissions, leurs évaluations de soumissions et éventuellement d'autres présentations publiées dans cette phase. | |||

==Évaluation de l'atelier== | ==Évaluation de l'atelier== | ||

Les notes pour l'activité Atelier sont obtenues progressivement à travers un processus de saisie et de calcul, puis elles sont finalisées et mémorisée dans le [[Carnet de notes|"Carnet de notes"]]. Le schéma suivant illustre le processus d'élaboration des deux notes finales et fournit également les noms des tables de base de données dans lesquelles les valeurs sont mémorisées. | |||

[[Image: | [[Image:schéma-notes-Atelier.jpg|400px|thumb|left|Schéma d'élaboration et calcul des notes de l'activité Atelier]] | ||

<br clear="all"/> | <br clear="all"/> | ||

Chaque participant obtient deux notes numériques pendant la phase d'évaluation. Ces notes sont ensuite enregistrée dans le cours "Carnet de notes". Pendant la phase d'évaluation, l'enseignant ou gestionnaire de cours peut laisser le module de l'atelier calculer ces notes finales, ou les éditer lui-même. Notez qu'il est possible de passer d'une phase à l'autre, même lorsque l'atelier a déjà été fermé. Ainsi, après la clôture de l'activité Atelier, vous pourriez y revenir pour annuler ou calculer à nouveau les notes. Une nouvelle fermeture de l'activité Atelier provoquerait la mise à jour des notes dans le cours "Carnet de notes". | |||

Par ailleurs, les notes peuvent être modifiées directement dans le "Carnet de notes" si nécessaire. | |||

Pendant l'exercice de notation, le rapport des notes de l'atelier vous donne un aperçu complet de toutes les notes individuelles. Le rapport utilise divers symboles et syntaxes: | |||

{| class="nicetable" | {| class="nicetable" | ||

|- | |- | ||

! | ! Valeur | ||

! | ! Signification | ||

|- | |- | ||

| - (-) < Alice | | - (-) < Alice | ||

| | | Un travail remis est soumis à l'évaluation d'Alice (attribution à Alice pour évaluation). Mais Alice n'a pas encore commenté ni noté ce travail. | ||

|- | |- | ||

| 68 (-) < Alice | | 68 (-) < Alice | ||

| Alice | | Alice a noté le travail avec 68 points. Mais la seconde note pour l'évaluation n'a pas encore été fixée. | ||

|- | |- | ||

| 23 (-) > | | 23 (-) > Robert | ||

| | | Le travail remis par Robert a été noté par un camarade, qui a attribué 23 points. La note pour cette évaluation n'a pas encore été fixée. | ||

|- | |- | ||

| 76 (12) < | | 76 (12) < Jeanne | ||

| | | Jeanne a noté le travail, attribuant 76 points. La note pour cette évaluation est fixée à 12. | ||

|- | |- | ||

| 67 (8) @ 4 < David | | 67 (8) @ 4 < David | ||

| David | | David a noté le travail, attribuant 67 points ; la note pour cette évaluation est de 8. Son évaluation a un poids de 4 pour le calcul de la moyenne pondérée. | ||

|- | |- | ||

| 80 (<del>20</del> / <ins>17</ins>) > Eve | | 80 (<del>20</del> / <ins>17</ins>) > Eve | ||

| Eve | | Le travail remis par Eve a été évalué par un camarade, avec une note de 80. L'évaluation a elle-même été noté à 20, mais l'enseignant a revu à la baisse cette seconde note, la fixant à 17. Il a probablement donné une explication pour justifier cette baisse. | ||

|} | |} | ||

=== Évaluation du travail remis === | === Évaluation du travail remis === | ||

La note finale de chaque travail remis correspond à la moyenne pondérée des notes d'évaluation particulières données par tous les examinateurs. La valeur est arrondie à un nombre de décimales défini dans le formulaire des paramètres de l'atelier. | |||

Le gestionnaire du cours (l'enseignant) peut moduler la note selon deux possibilités : | |||

* En attribuant lui-même une note, à laquelle est fixé un coefficient de pondération supérieur à ceux donnés aux différents pairs examinateurs. | |||

* En corrigeant la note finale elle-même | |||

=== Estimation de l'évaluation des pairs === | |||

La note d'évaluation permet d'estimer la qualité des évaluations que le participant a données ses pairs. Cette note est calculée par une formule cachée, parce qu'elle est supposée faire un travail dévolu à l'enseignant. | |||

Au cours de la phase d'évaluation des travaux, un sous-module de l'activité Atelier est utilisé pour calculer les notes pour l'évaluation. Actuellement, par défaut, un seul sous-module standard est disponible ; il agit par "comparaison avec la meilleure évaluation". Notez que d'autres plugins d'évaluation de notation peuvent être trouvés dans [https://moodle.org/plugins/browse.php?list=category&id=17|la bibliothèque de modules ou "plugins" de Moodle]). | |||

Voici la méthode utilisée pour le calcul par "comparaison avec la meilleure évaluation" : | |||

Les notes pour l'évaluation sont affichées entre parenthèses () dans le rapport de l'atelier. La note finale pour l'évaluation est calculée comme la moyenne de ces notes particulières. | |||

La formule globale n'est pas simple à décrire, cependant elle est "déterministe" : | |||

# La note la plus proche de la moyenne des notes est considérée comme étant "la meilleure" pas l’algorithme. On suppose que cette note serait consensuelle pour la majorité des examinateurs. | |||

# A cette note de référence est attribué un poids de 100%. | |||

# A chacune des autres notes, on attribue un poids inférieur à 100%, en proportion de l'écart (différence) constaté par rapport à la note de référence ("la meilleure"). | |||

La pertinence du calcul dépend de notre façon d'apprécier le rythme d'arrivée des notes particulières, en corrélation avec les écarts constatés par rapport à la note "la meilleure" : | |||

S'il n'y a que deux évaluations par soumission, l'algorithme ne peut pas décider laquelle d'elles est «la meilleure». Imaginez que vous ayez deux critiques - Alice et Robert. Ils évaluent tous deux la présentation de Jeanne. Alice dit que c'est un travail pitoyable et Robert prétend à l'opposé que c'est excellent. L'algorithme n'a aucun moyen de décider qui est juste. Il attribue simplement une note de 100% à chaque évaluation. Afin d'éviter cela, vous avez deux options : | |||

* Soit vous fournissez une évaluation supplémentaire, de telle sorte que le nombre d'examinateurs devienne impair, et que l'algorithme puisse déterminer une note comme étant "la meilleure". Généralement, l'enseignant fournit sa propre évaluation. | |||

* Soit vous décidez de faire davantage confiance à l'un des participants aux évaluations. Par exemple, Alice ayant la réputation de fournir habituellement des évaluations plutôt pertinentes, vous décidez d'augmenter le poids de son évaluation, en le portant à 2 (par défaut, il est de 1). L'évaluation d'Alice sera alors prise en compte deux fois, comme si deux examinateurs avaient exactement la même opinion ; aussi cette évaluation est-elle susceptible d'être choisie comme la meilleure. | |||

'''Nota 1 : Compatibilité ascendante des versions''' | |||

En version 1.x de l'activité Atelier, ce cas spécifique où deux évaluateurs ont exactement la même pondération n'est pas résolu correctement et conduit à des résultats erronés. En effet, un poids de 100% n'est effectivement attribué qu'à un seul des évaluateurs, l'autre étant affecté d'un poids inférieur. | |||

'''Nota 2 : ce ne sont pas seulement les notes finales qui sont comparées''' | |||

Il est très important de savoir que le calcul de pondération réalisé par le sous-module de "comparaison avec la meilleure évaluation" ne se fait pas immédiatement sur les "notes finales" attribuées, mais sur chacun des critères permettant d'obtenir ces "notes finales" ; les critères étant définis selon la stratégie de classement utilisée. | |||

'' | En effet, selon la stratégie, chaque formulaire d'évaluation saisi peut être considéré comme un vecteur à n dimensions, remplies avec des valeurs normalisées, permettant d'élaborer la note finale. Ce sont d'abord toutes ces valeurs que le sous-module compare, les unes aux autres selon chaque dimension (le rang de la valeur dans le vecteur, correspondant à un critère ou une assertion du formulaire). Ensuite, l’algorithme calcule la "distance" entre deux valeurs, telle la différence de variance statistique. | ||

A titre d'exemple, dans le cadre d'une évaluation par les pairs d'essais de recherche, supposons que vous utilisiez la stratégie de classement appelée "Nombre d'erreurs". Avec cette méthode, des commentaires sont donnés par les évaluateurs, ainsi qu'une évaluation oui/non sur des critères ou assertions présentés dans une liste. Disons que lors de la configuration du formulaire d'évaluation, vous avez définis une liste de trois critères : | |||

' | # L'auteur indique-t-il clairement le but de la recherche? (Oui Non) | ||

# La méthodologie de recherche est-elle décrite? (Oui Non) | |||

# Les références sont-elles correctement citées? (Oui Non) | |||

Lors de la configuration du formulaire, vous avez pu indiquer comment la note finale est calculée. Disons que lors de l'évaluation d'un travail remis, l'auteur obtient une note de : | |||

* 100% si l'ensemble des trois assertions est passée à "oui" | |||

* 75 % si deux critères sont passés à "oui" | |||

* 25 % si un seul critère est validé par "oui" | |||

* 0% si chacun des trois critères est passé à "non". | |||

Maintenant, imaginons que le travail de Daniel est revu par trois camarades, Alice, Robert et Eve. Tous saisissent individuellement leurs propres réponses pour chacune des assertions : | |||

* Alice : oui / oui / non | |||

* Robert : oui / oui / non | |||

* Eve : non / oui / oui | |||

Comme vous pouvez le calculer, chacun aura donc donné une note finale de 75% au travail de Daniel. Cependant Alice et Robert s'accordent également sur chacun des critères constituant l'évaluation, alors que l'appréciation détaillée d'Eve est différente. L'algorithme de «comparaison avec la meilleure évaluation» est un moyen permettant d'établir une note finale selon une méthode qui reflèterait une évaluation absolument équitable. Dans [[Développement: Atelier 2.0 spécification|ses spécifications du programme]], David explique qu'il s'est demandé comment Zeus aurait noté ce travail ?. Nous estimons (insidieusement) que la note ressemblerait à cela : | |||

* Zeus 66% oui / 100% oui / 33% oui | |||

Alors nous cherchons quelles sont les évaluations les plus proches de cette estimation supposée objective. Nous comprenons qu'Alice et Robert sont les "meilleurs" et attribuons donc une note de 100% à leurs évaluations. Ensuite nous calculons la "distance" de l'évaluation d'Eve, par rapport à la meilleure évaluation (i.e. indifféremment celle de Robert ou celle d'Alice, puisqu'elles sont identiques). Comme dans l'évaluation faite par Eve, la valeur d'un seul critère correspond à la meilleure valeur, alors le poids de l'évaluation d'Eve ne sera pas très élevé. | |||

La même logique s'applique à toutes les autres stratégies de classement, de façon adéquate. | |||

En conclusion, la note donnée par le meilleur évaluateur n'est pas nécessairement la plus proche de la moyenne des notes, puisque les évaluations sont comparées au niveau des réponses individuelles et détaillées, non pas au niveau des notes finales. | |||

==Groupes et groupements== | |||

Quand l'activité Atelier est utilisée dans un cours proposant les fonctions de groupements et de groupes séparés ou visibles, alors il est possible de filtrer par groupe grâce à des menus déroulants présents dans certaines phases ou certaines pages de l'activité ( phase d'évaluation, page d'allocation manuelle, rapport sur les notes ...) | |||

[[File:workshopdropdown.png |thumb|none|upright=2.0|alt="Group filtering" | Group filtering drop down]] | [[File:workshopdropdown.png |thumb|none|upright=2.0|alt="Group filtering" | Group filtering drop down]] | ||

| Ligne 134 : | Ligne 166 : | ||

* [http://www.moodleblog.net/2010/02/15/a-brief-journey-into-the-moodle-2-0-workshop/ A Brief Journey into the Moodle 2.0 Workshop] from moodlefairy's blog. | * [http://www.moodleblog.net/2010/02/15/a-brief-journey-into-the-moodle-2-0-workshop/ A Brief Journey into the Moodle 2.0 Workshop] from moodlefairy's blog. | ||

[[ | [[en:Using_Workshop]] | ||

[[es:Uso de taller]] | [[es:Uso de taller]] | ||

Version du 28 février 2017 à 10:05

Remarque : la traduction de cette page n'est pas terminée. N'hésitez pas à traduire tout ou partie de cette page ou à la compléter. Vous pouvez aussi utiliser la page de discussion pour vos recommandations et suggestions d'améliorations.

Objet de l'activité Atelier

L'atelier permet l'évaluation par les pairs et contient de nombreuses options permettant des scénarios pédagogiques complexes. Reportez vous à la page dédiée à la présentation de cette activité dans la documentation pour en comprendre l'intérêt.

Étapes de fonctionnement de l'atelier

L'activité atelier fonctionne selon un processus en cinq étapes. Le processus complet de travail dans un atelier peut se dérouler sur plusieurs jours voire plusieurs semaines. C'est l’enseignant qui décide de la commutation des différentes phases.

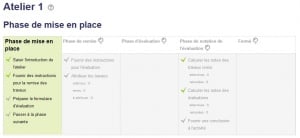

Le travail dans l'atelier suit un processus linéaire passant par les étapes suivantes : Mise en place, Remise des travaux, Évaluation, Notation de l'évaluation, et se termine par l'étape Fermé. Cependant, un processus par itérations successives reste possible.

La progression de l'activité peut être suivie dans l'écran de planification de l'activité. Celui-ci affiche les phases possibles de l'Atelier en surlignant la phase en cours. Les tâches à exécuter par le participant sont listées pour chaque étudiant avec une indication si la tâche est finie, à finir ou éventuellement invalidée.

Étape de mise en place

Dans cette première étape, les participants à l'atelier ne peuvent rien faire (ni corriger les travaux rendus, ni modifier leurs évaluations).

Les enseignants, gestionnaires ou animateurs du cours utilisent cette phase pour configurer les paramètres de l'atelier et définir la stratégie de classement des formulaires d'évaluation. Vous pouvez activer cette étape chaque fois que vous avez besoin de régler les paramètres de l'atelier ou d'empêcher les utilisateurs de modifier leur travail.

Étape de remise des travaux

Dans la phase de remise des travaux, les participants à l'atelier présentent leur travail ("soumission des travaux").

Des dates de contrôle d'accès peuvent être définies de telle sorte que, même si l'Atelier est maintenu dans cette phase, la possibilité de remise des travaux est limitée à la période donnée. Il est possible d'indiquer une date (et heure) de début de remise du travail, ainsi qu'une date de fin, ou les deux.

Étape d'évaluation par les pairs

Si la configuration de l'Atelier prévoit l'évaluation par les pairs, c'est la phase où les participants à l'atelier apprécient les travaux qui leur sont soumis à évaluation.

Comme dans la phase de remise des travaux, l'accès peut être limité par des groupes horaires de début et de fin d'autorisation d'évaluation.

Étape de notation des évaluations

L'objet principal de cette phase est de calculer deux notes finales. En effet, les participants reçoivent une note pour leur travail (calculée sur base des évaluations faites par les différents participants), ainsi qu'une note pour la qualité des évaluations qu'ils ont fournies.

Cette étape permet aussi de fournir les commentaires d'évaluations pour les auteurs et les examinateurs.

Les participants à l'atelier ne peuvent plus modifier leurs soumissions ou leurs évaluations pendant cette phase. Les gestionnaires de cours peuvent annuler manuellement les notes calculées. En outre, les soumissions sélectionnées peuvent être définies comme étant publiées afin qu'elles soient disponibles pour tous les participants à l'atelier dans la phase suivante. Voir la page des questions fréquentes sur l'activité Atelier pour obtenir des instructions sur la façon de publier des soumissions.

Fermeture de l'atelier

Chaque fois que l'Atelier passe à cette phase, les notes finales calculées au cours de la phase précédente sont insérées dans le cours Carnet de notes. Les notes de l'Atelier figurant dans le Carnet de notes et dans l'atelier. Les participants peuvent consulter leurs soumissions, leurs évaluations de soumissions et éventuellement d'autres présentations publiées dans cette phase.

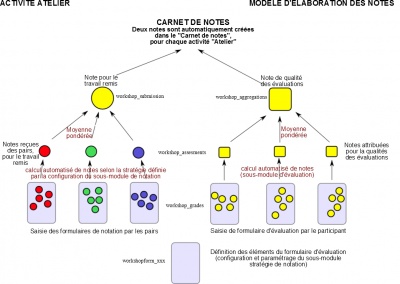

Évaluation de l'atelier

Les notes pour l'activité Atelier sont obtenues progressivement à travers un processus de saisie et de calcul, puis elles sont finalisées et mémorisée dans le "Carnet de notes". Le schéma suivant illustre le processus d'élaboration des deux notes finales et fournit également les noms des tables de base de données dans lesquelles les valeurs sont mémorisées.

Chaque participant obtient deux notes numériques pendant la phase d'évaluation. Ces notes sont ensuite enregistrée dans le cours "Carnet de notes". Pendant la phase d'évaluation, l'enseignant ou gestionnaire de cours peut laisser le module de l'atelier calculer ces notes finales, ou les éditer lui-même. Notez qu'il est possible de passer d'une phase à l'autre, même lorsque l'atelier a déjà été fermé. Ainsi, après la clôture de l'activité Atelier, vous pourriez y revenir pour annuler ou calculer à nouveau les notes. Une nouvelle fermeture de l'activité Atelier provoquerait la mise à jour des notes dans le cours "Carnet de notes".

Par ailleurs, les notes peuvent être modifiées directement dans le "Carnet de notes" si nécessaire.

Pendant l'exercice de notation, le rapport des notes de l'atelier vous donne un aperçu complet de toutes les notes individuelles. Le rapport utilise divers symboles et syntaxes:

| Valeur | Signification |

|---|---|

| - (-) < Alice | Un travail remis est soumis à l'évaluation d'Alice (attribution à Alice pour évaluation). Mais Alice n'a pas encore commenté ni noté ce travail. |

| 68 (-) < Alice | Alice a noté le travail avec 68 points. Mais la seconde note pour l'évaluation n'a pas encore été fixée. |

| 23 (-) > Robert | Le travail remis par Robert a été noté par un camarade, qui a attribué 23 points. La note pour cette évaluation n'a pas encore été fixée. |

| 76 (12) < Jeanne | Jeanne a noté le travail, attribuant 76 points. La note pour cette évaluation est fixée à 12. |

| 67 (8) @ 4 < David | David a noté le travail, attribuant 67 points ; la note pour cette évaluation est de 8. Son évaluation a un poids de 4 pour le calcul de la moyenne pondérée. |

| 80 ( |

Le travail remis par Eve a été évalué par un camarade, avec une note de 80. L'évaluation a elle-même été noté à 20, mais l'enseignant a revu à la baisse cette seconde note, la fixant à 17. Il a probablement donné une explication pour justifier cette baisse. |

Évaluation du travail remis

La note finale de chaque travail remis correspond à la moyenne pondérée des notes d'évaluation particulières données par tous les examinateurs. La valeur est arrondie à un nombre de décimales défini dans le formulaire des paramètres de l'atelier.

Le gestionnaire du cours (l'enseignant) peut moduler la note selon deux possibilités :

- En attribuant lui-même une note, à laquelle est fixé un coefficient de pondération supérieur à ceux donnés aux différents pairs examinateurs.

- En corrigeant la note finale elle-même

Estimation de l'évaluation des pairs

La note d'évaluation permet d'estimer la qualité des évaluations que le participant a données ses pairs. Cette note est calculée par une formule cachée, parce qu'elle est supposée faire un travail dévolu à l'enseignant.

Au cours de la phase d'évaluation des travaux, un sous-module de l'activité Atelier est utilisé pour calculer les notes pour l'évaluation. Actuellement, par défaut, un seul sous-module standard est disponible ; il agit par "comparaison avec la meilleure évaluation". Notez que d'autres plugins d'évaluation de notation peuvent être trouvés dans bibliothèque de modules ou "plugins" de Moodle).

Voici la méthode utilisée pour le calcul par "comparaison avec la meilleure évaluation" :

Les notes pour l'évaluation sont affichées entre parenthèses () dans le rapport de l'atelier. La note finale pour l'évaluation est calculée comme la moyenne de ces notes particulières. La formule globale n'est pas simple à décrire, cependant elle est "déterministe" :

- La note la plus proche de la moyenne des notes est considérée comme étant "la meilleure" pas l’algorithme. On suppose que cette note serait consensuelle pour la majorité des examinateurs.

- A cette note de référence est attribué un poids de 100%.

- A chacune des autres notes, on attribue un poids inférieur à 100%, en proportion de l'écart (différence) constaté par rapport à la note de référence ("la meilleure").

La pertinence du calcul dépend de notre façon d'apprécier le rythme d'arrivée des notes particulières, en corrélation avec les écarts constatés par rapport à la note "la meilleure" :

S'il n'y a que deux évaluations par soumission, l'algorithme ne peut pas décider laquelle d'elles est «la meilleure». Imaginez que vous ayez deux critiques - Alice et Robert. Ils évaluent tous deux la présentation de Jeanne. Alice dit que c'est un travail pitoyable et Robert prétend à l'opposé que c'est excellent. L'algorithme n'a aucun moyen de décider qui est juste. Il attribue simplement une note de 100% à chaque évaluation. Afin d'éviter cela, vous avez deux options :

- Soit vous fournissez une évaluation supplémentaire, de telle sorte que le nombre d'examinateurs devienne impair, et que l'algorithme puisse déterminer une note comme étant "la meilleure". Généralement, l'enseignant fournit sa propre évaluation.

- Soit vous décidez de faire davantage confiance à l'un des participants aux évaluations. Par exemple, Alice ayant la réputation de fournir habituellement des évaluations plutôt pertinentes, vous décidez d'augmenter le poids de son évaluation, en le portant à 2 (par défaut, il est de 1). L'évaluation d'Alice sera alors prise en compte deux fois, comme si deux examinateurs avaient exactement la même opinion ; aussi cette évaluation est-elle susceptible d'être choisie comme la meilleure.

Nota 1 : Compatibilité ascendante des versions

En version 1.x de l'activité Atelier, ce cas spécifique où deux évaluateurs ont exactement la même pondération n'est pas résolu correctement et conduit à des résultats erronés. En effet, un poids de 100% n'est effectivement attribué qu'à un seul des évaluateurs, l'autre étant affecté d'un poids inférieur.

Nota 2 : ce ne sont pas seulement les notes finales qui sont comparées

Il est très important de savoir que le calcul de pondération réalisé par le sous-module de "comparaison avec la meilleure évaluation" ne se fait pas immédiatement sur les "notes finales" attribuées, mais sur chacun des critères permettant d'obtenir ces "notes finales" ; les critères étant définis selon la stratégie de classement utilisée.

En effet, selon la stratégie, chaque formulaire d'évaluation saisi peut être considéré comme un vecteur à n dimensions, remplies avec des valeurs normalisées, permettant d'élaborer la note finale. Ce sont d'abord toutes ces valeurs que le sous-module compare, les unes aux autres selon chaque dimension (le rang de la valeur dans le vecteur, correspondant à un critère ou une assertion du formulaire). Ensuite, l’algorithme calcule la "distance" entre deux valeurs, telle la différence de variance statistique.

A titre d'exemple, dans le cadre d'une évaluation par les pairs d'essais de recherche, supposons que vous utilisiez la stratégie de classement appelée "Nombre d'erreurs". Avec cette méthode, des commentaires sont donnés par les évaluateurs, ainsi qu'une évaluation oui/non sur des critères ou assertions présentés dans une liste. Disons que lors de la configuration du formulaire d'évaluation, vous avez définis une liste de trois critères :

- L'auteur indique-t-il clairement le but de la recherche? (Oui Non)

- La méthodologie de recherche est-elle décrite? (Oui Non)

- Les références sont-elles correctement citées? (Oui Non)

Lors de la configuration du formulaire, vous avez pu indiquer comment la note finale est calculée. Disons que lors de l'évaluation d'un travail remis, l'auteur obtient une note de :

- 100% si l'ensemble des trois assertions est passée à "oui"

- 75 % si deux critères sont passés à "oui"

- 25 % si un seul critère est validé par "oui"

- 0% si chacun des trois critères est passé à "non".

Maintenant, imaginons que le travail de Daniel est revu par trois camarades, Alice, Robert et Eve. Tous saisissent individuellement leurs propres réponses pour chacune des assertions :

- Alice : oui / oui / non

- Robert : oui / oui / non

- Eve : non / oui / oui

Comme vous pouvez le calculer, chacun aura donc donné une note finale de 75% au travail de Daniel. Cependant Alice et Robert s'accordent également sur chacun des critères constituant l'évaluation, alors que l'appréciation détaillée d'Eve est différente. L'algorithme de «comparaison avec la meilleure évaluation» est un moyen permettant d'établir une note finale selon une méthode qui reflèterait une évaluation absolument équitable. Dans ses spécifications du programme, David explique qu'il s'est demandé comment Zeus aurait noté ce travail ?. Nous estimons (insidieusement) que la note ressemblerait à cela :

- Zeus 66% oui / 100% oui / 33% oui

Alors nous cherchons quelles sont les évaluations les plus proches de cette estimation supposée objective. Nous comprenons qu'Alice et Robert sont les "meilleurs" et attribuons donc une note de 100% à leurs évaluations. Ensuite nous calculons la "distance" de l'évaluation d'Eve, par rapport à la meilleure évaluation (i.e. indifféremment celle de Robert ou celle d'Alice, puisqu'elles sont identiques). Comme dans l'évaluation faite par Eve, la valeur d'un seul critère correspond à la meilleure valeur, alors le poids de l'évaluation d'Eve ne sera pas très élevé.

La même logique s'applique à toutes les autres stratégies de classement, de façon adéquate.

En conclusion, la note donnée par le meilleur évaluateur n'est pas nécessairement la plus proche de la moyenne des notes, puisque les évaluations sont comparées au niveau des réponses individuelles et détaillées, non pas au niveau des notes finales.

Groupes et groupements

Quand l'activité Atelier est utilisée dans un cours proposant les fonctions de groupements et de groupes séparés ou visibles, alors il est possible de filtrer par groupe grâce à des menus déroulants présents dans certaines phases ou certaines pages de l'activité ( phase d'évaluation, page d'allocation manuelle, rapport sur les notes ...)

Voir aussi

- Example workshop with data Log in with username teacher/password moodle and explore the grading and phases of a completed workshop on the Moodle School demo site.

- Research paper Moodle Workshop activities support peer review in Year 1 Science: present and future by Julian M Cox, John Paul Posada and Russell Waldron

- Using Moodle Workshop module forum

- Using Moodle forum discussion [1] where David explains a particular Workshop results

- Moodle Workshop 2.0 - a (simplified) explanation presentation by Mark Drechsler

- Development:Workshop for more information on the module infrastructure and ways how to extend provided functionality by developing own Workshop subplugins

- A Brief Journey into the Moodle 2.0 Workshop from moodlefairy's blog.